MISE EN CONTEXTE DU TEXTE DE CLAUDE COLLIN

Le « Test PERPE/Philo » (Perceptions des Étudiants de la Relation Pédagogique et de son Efficacité, version Philosophie) représente l’aboutissement technique et scientifique de la démarche de « Claude Collin » et de l’« Institut de recherches didactiques de Laval ».

Ce test n’est pas un simple questionnaire de satisfaction, mais un instrument de mesure psychopédagogique rigoureux conçu pour transformer l’enseignement de la philosophie au collégial en une science expérimentale.

1. Origine et fondements théoriques

Le PERPE tire ses origines des travaux du professeur belge « Gilbert De Landsheere (VOIR AUSSI). Au début des années 1970, Claude Collin cherche un outil capable de valider scientifiquement ses intuitions pédagogiques et de répondre au « flou » qu’il reproche aux réformes administratives (comme le Rapport Roquet).

Il adapte alors cet instrument pour créer le « PERPE/Philo ». L’idée fondamentale est que la qualité de l’apprentissage ne dépend pas seulement du contenu du programme, mais de la « relation pédagogique » perçue par l’étudiant.

2. Le fonctionnement du test : La triple mesure

Le test repose sur un questionnaire complexe soumis aux étudiants (et souvent au professeur lui-même pour comparaison). Il mesure trois dimensions critiques :

-

« Le Réel (Le Perçu) » : L’étudiant décrit ce qu’il vit réellement en classe. (Exemple : « Le professeur encourage-t-il la discussion ? »)

-

« L’Idéal (L’Attente) » : L’étudiant décrit ce qu’il considérerait comme une situation d’apprentissage parfaite.

-

« L’Écart (L’Indice d’Efficience) » : C’est la donnée la plus précieuse. Plus l’écart entre le « réel » et l’« idéal » est grand, plus la relation pédagogique est jugée inefficace ou insatisfaisante par l’étudiant.

3. Les catégories analysées (Les Variables)

Le PERPE/Philo ne juge pas la personnalité du professeur, mais des comportements pédagogiques précis, regroupés en plusieurs facteurs :

-

« L’intérêt pour l’étudiant : » Le professeur est-il disponible ? Respecte-t-il les opinions des élèves ?

-

« La compétence didactique : » La matière est-elle présentée clairement ? Le passage des concepts abstraits aux exemples concrets est-il réussi ?

-

« L’incitation à la réflexion : » Le cours pousse-t-il l’étudiant à remettre en question ses propres préjugés (le cœur de la méthode Collin) ?

-

« L’évaluation : » Les critères de correction sont-ils perçus comme justes et formateurs ?

4. Pourquoi est-ce lié à Claude Collin ?

Claude Collin utilisait le PERPE/Philo comme un outil de « recherche-action ». Pour lui, c’était l’arme ultime contre la « démagogie pédagogique ».

-

« Preuve scientifique » : Collin pouvait démontrer, chiffres à l’appui, que sa « méthode inductive » (partir de l’expérience de l’étudiant) réduisait les écarts entre le réel et l’idéal.

-

« Contre-pouvoir » : Face aux inspecteurs ou aux réformateurs du ministère, il opposait la rigueur statistique des résultats du PERPE collectés par son Institut.

-

« Auto-perfectionnement » : Contrairement à l’évaluation administrative, le PERPE/Philo permettait au professeur de voir ses propres « zones aveugles » (là où sa perception de son cours différait radicalement de celle de ses élèves).

5. L’impact sur l’enseignement de la philosophie

L’usage du PERPE/Philo a permis de définir ce que Collin appelait la « Didactique expérimentale ». Grâce aux données compilées par l’Institut de recherches didactiques de Laval, la philosophie au Québec est passée d’une tradition de « cours magistral » à une approche plus interactive et centrée sur le développement de l’étudiant.

Le test permettait de valider si l’étudiant « apprenait à philosopher » ou s’il « apprenait simplement de la philosophie ». Pour Collin, si le test révélait un écart massif dans la catégorie « incitation à la réflexion », c’est que l’essence même de la discipline était perdue.

Conclusion

En résumé, le « Test PERPE/Philo » est le thermomètre scientifique de la salle de classe. Il a permis de sortir la pédagogie de la philosophie de l’opinion pour l’amener vers la mesure. Il reste l’un des héritages les plus tangibles de l’Institut de Claude Collin, prouvant que la rigueur philosophique peut s’allier à la rigueur des sciences sociales pour améliorer l’éducation.

Alors que le Rapport Roquet se basait sur des consultations générales, Claude Collin s’appuyait sur les données rigoureuses de l’étude de Gagné et Chabot (mars 1970), qui démontraient scientifiquement les lacunes de la relation pédagogique en philosophie.

Ce document (PERPE, une conception neuve du perfectionnement pédagogique par François GAGNÉ et Marie CHABOT) est la matière première sur laquelle Collin a travaillé. Il n’en est pas l’auteur, mais il en est l’interprète principal.

Gagné a fourni le « thermomètre » (le test), et Collin a posé le « diagnostic » (la critique de l’enseignement actuel) et proposé le « traitement » (sa méthode inductive). C’est cette collaboration indirecte entre la psychométrie de Gagné et la philosophie de Collin qui a révolutionné la pédagogie au collégial.

TEXTE DE CLAUDE COLLIN

SOMMAIREIntroductionLes faiblesses du test PERPE-PHILOConséquences de l’utilisation de ce testCe qu’il faudrait faire |

Introduction

LES PROFESSEURS de (Philosophie du niveau collégial recevaient, dernièrement, les (Résultats d’une première expérimentation du Test PERPE/PHILO ». Ce document est l’œuvre d’une équipe de chercheurs mise sur pied par: le (Comité provincial des programmes de philosophie », dans le but de travailler à la perfection d’un instrument scientifique d’évaluation des cours.

Étant donné l’importance que semblent vouloir attacher à ce document les responsables de l’éducation[2] nous croyons qu’il ne serait pas inutile d’attirer leur attention sur certaines faiblesses de ce document, faiblesses que nous jugeons importantes.

Les faiblesses du test PERPE-PHILO

Nous ne croyons pas, en réalité, que ce test puisse servir à autre chose qu’à explorer l’état psychologique des étudiants, tout comme le ferait une enquête sociologique.

Un instrument/ d’évaluation de cours doit comporter les caractères nécessaires à toute évaluation, c’est-à-dire 1 0) un donné quantifiable objectivement, 2 0) un critère objectif d’évaluation et 3 0) une échelle de mesure. Malheureusement, le test PERPE/PHILO ne renferme pas ces caractéristiques essentielles à toute évaluation. Il est conçu comme un questionnaire au moyen duquel les étudiants peuvent évaluer leurs cours « subjectivement ». Il ressort de la lecture attentive du document, que les dimensions proposées invitent les étudiants à exprimer leurs perceptions subjectives au sujet de la réalité pédagogique, elle-même stratifiée arbitrairement. Non seulement les dites dimensions ne sont pas quantifiées, mais plusieurs ne sont pas facilement quantifiables ou ne le sont pas du tout. Par exemple, les dimensions suivantes, pour n’en citer que quelques-unes: l’implication humaine, la clarté, la synthèse, etc. Comment l’étudiant peut-il savoir si le cours contient suffisamment d’implication humaine, de clarté, de synthèse? Il nous semble justement qu’il doit apprendre, au moyen du cours de philosophie, ces concepts.

Pour rendre les données du i test conformes aux exigences scientifiques, il faudrait de plus, utiliser des critères adéquats. Par exemple, en ce qui concerne le « volume de la lecture » imposé, on devrait, tout d’abord, introduire une certaine quantification; soit l’expression du « volume de lecture » en chapitres, pages, etc., et ensuite, la délimitation du temps qu’on estime souhaitable pour la lecture d’un certain volume, exprimée, elle aussi, en unité de temps qu’on peut compter. De cette façon, l’étudiant serait réellement capable de porter un jugement valable sur l’aspect « volume de lecture » imposé par le professeur. Si je dois lire un ouvrage de 100 pages en six mois, je juge alors que 12 pages en quatre mois c’est trop peu. Mais, au moins, je peux dire pourquoi c’est trop peu. Prenons un autre exemple. L’étudiant qui affirme que le professeur propose rarement des solutions. Est-ce que cela signifie une solution à tous les 3, 5 ou 10 problèmes ? Ce n’est qu’une échelle objective, fournie par des études expérimentales préalables et relatives au problème en question qui peut nous fournir les critères d’évaluation. Les termes « rarement », « souvent », etc., en tant qu’appréciation subjective, cèdent alors leur place à un jugement beaucoup plus objectif. L’opinion exprimée par les étudiants a, cependant, une grande valeur sociologique et psychologique. Mais elle ne peut nullement constituer une évaluation de la réalité pédagogique.

Une autre faiblesse importante du document, qui enlève beaucoup de portée aux résultats statistiques, réside dans la conception pédagogique particulière des auteurs, en ce qui concerne la notion de test et la notion de fait pédagogique.

Dès l’introduction, nous pouvons constater que leur conception du test pédagogique s’éloigne considérablement de celle généralement admise par les plus éminents pédagogues. Si l’on se réfère au professeur Buyse, par exemple, on entend pas test pédagogique, «des épreuves simples, rapides, mais aussi précises que possible, qui donnent de véritables coups de sonde dans un sujet donné et qui, répétées sur un grand nombre de cas, dans des circonstances à peu près identiques, permettent d’établir, pour un ensemble de fonctions mentales ou pour une aptitude spéciale, les normes de «rendement» d’un groupe déterminé de sujets.»• (cf. L’Expérimentation en Pédagogie, p. 201). En d’autres termes, le test pédagogique est une épreuve imposée à quelqu’un, dont on observe le comportement mental et dont on mesure les résultats. or, les auteurs du test PERPE/PHILO le définissent comme un questionnaire au moyen duquel les étudiants peuvent évaluer leurs cours et leurs professeurs (p. 2). Il ne s’agit donc pas, dans l’esprit des auteurs, de mesurer soit, d’une part, les capacités des étudiants, l’acquisition de leurs connaissances ou le développement de leurs facultés (i.e. le degré d’apprentissage); soit, d’autre part, de mesurer le degré d’efficacité des méthodes utilisées par leurs professeurs.

Si ce test n’est pas un test pédagogique, c’est qu’il ne respecte pas les conditions nécessaires à une recherche scientifique dans le sens universellement accepté, à savoir l’observation des faits pédagogiques, l’objectivité, la mensuration, etc. La réalité pédagogique dans laquelle se trouve l’étudiant lors de son apprentissage philosophique ne peut être étudiée objectivement si la conception scientifique et les conditions scientifiques ne sont pas observées.

En effet, toute recherche doit se baser sur l’observation dûment conduite des faits, la formulation d’une hypothèse ou d’un problème et d’une théorie qui explique ces faits. Or, ce questionnaire ne nous renseigne pas sur les faits pédagogiques dûment observés, puisque l’observation porte sur des données qui ne sont pas strictement pédagogiques, mais psychologiques. Car, si l’insatisfaction des étudiants constitue un élément psychologique dans leur comportement social et personnel, elle ne trouve certainement pas sa place dans la problématique pédagogique proprement dite. Or, en pédagogie, la détermination des faits doit être positive. Il en résulte que, comparer deux faits subjectifs ne constitue pas un fait pédagogique.

Ce que l’on mesure avec PERPE/PHILO, c’est l’écart entre ce qui apparaît aux étudiants et ce à quoi ils s’attendaient. Les deux données étant l’expression d’une introspection à l’occasion d’une situation pédagogique, elles ne peuvent nullement être considérées comme un jugement de l’objectivité de la situation pédagogique. Il est vrai qu’on peut considérer des opinions recueillies auprès des étudiants comme des données suffisamment étayées, mais, si l’on oppose à ces données d’autres données qui sont également subjectives, il s’ensuit que les résultats obtenus n’ont aussi qu’une valeur subjective.

En effet, pour les auteurs de PERPE/PHILO, la relation entre deux opinions émises constitue un fait scientifique. Mais il doit être considéré comme un fait scientifique psychologique. Leur calcul ne peut manifester que le degré d’intensité des sentiments des étudiants. En résumé, la différence entre l’attente des étudiants et leur appréciation de la réalité constitue un degré subjectif d’insatisfaction. Et, même si on transpose en valeur numérique ces phénomènes subjectifs, et bien que ces phénomènes se réfèrent à une situation pédagogique. cette quantification ne fait pas qu’il s’agisse d’une recherche pédagogique. Car toute recherche pédagogique doit se baser sur la connaissance objective des faits pédagogiques. Le fait pédagogique, faut-il le rappeler, se définit comme tout changement qu’on observe dans le comportement d’un sujet, suite à l’activité de l’apprentissage. Il s’ensuit que le fait pédagogique con283

tient plusieurs éléments essentiels, à savoir: le genre d’apprentissage à conférer à l’individu, la tâche précise à accomplir par l’étudiant et la réaction de l’étudiant face à cette tâche. Or, l’étude en question (PERPE/ PHILO) ne nous fournit pas suffisamment d’objectivité sur les données pédagogiques pour qu’on puisse le considérer comme un instrument valable du point de vue pédagogique. Pour qu’un instrument puisse réaliser ces conditions, il faudrait qu’il soit élaboré à la base des données psychologiques obtenues par et pendant l’enseignement de la philosophie elle-même. A notre connaissance, les recherches de ce genre n’ont pas encore été conduites et nous doutons fortement que le test PERPE/PHILO puisse remplir son ambition en l’absence de ces données scientifiques.

Conséquences de l’utilisation de ce test

Il est bien évident qu’un document semblable laisse intacte la problématique de l’enseignement de la philosophie. Il ne touche pas le fait pédagogique. Il n’est nulle part question d’un changement provoqué par l’acquisition d’une connaissance ou d’une capacité opérationnelle. On ne peut savoir, après ce test, si les étudiants ont pu apprendre quelque chose, i.e. si leur comportement intellectuel a pu changer. On ne peut savoir, non plus, si la méthode utilisée par le professeur possède quelque efficacité. Autrement dit, le problème de l’enseignement reste entier. Et tous les documents de ce genre ne pourront jamais résoudre les questions les plus fondamentales. Bien au contraire, si l’on continue dans cette veine, on contribuera à accentuer le désarroi actuel de l’enseignement philosophique. Car ce test ouvre la porte à un grand nombre d’abus.

En effet, on en vient à favoriser toutes sortes d’expériences plus ou moins arbitraires et hétérogènes, dans le but, semble-t-il, de plaire aux étudiants: méthode non-directive, auto-évaluation, utilisation peut-être abusive des moyens audio-visuels, etc. L’important, semble-t-il, n’est plus d’enseigner à philosopher, mais d’amuser les étudiants, comme si l’on doutait que la philosophie puisse être de quelque intérêt sérieux pour les étudiants d’aujourd’hui.

Rien d’étonnant, après cela, que les responsables des programmes proposent à chaque année un programme nouveau, avec des objectifs et des moyens pédagogiques nouveaux. (cf. les programmes de la Direction générale de l’enseignement collégial ces trois dernières années.) Il n’est pas surprenant, non plus, dans ce contexte, que le Rapport Roquet[3] propose de diminuer le nombre d’heures consacrées à l’enseignement de la philosophie au niveau collégial. Si les professeurs de philosophie, comme groupe, ne donnent pas un coup de barre dans la bonne direction, on peut sans doute prévoir qu’à plus ou moins brève échéance, le cours de philosophie deviendra facultatif, avant de sombrer dans la pure fantaisie.

Ce qu’il faudrait faire

Il serait pourtant possible d’aider à la solution des problèmes concernant l’enseignement de la philosophie, si l’on acceptait de procéder scientifiquement à l’analyse de l’aspect didactique de la relation professeur-étudiant dans son rapport avec les exigences de la philosophie comme discipline de l’esprit.

Ce qu’il faut connaître de l’étudiant qui entreprend des études philosophiques, ce n’est pas son degré de satisfaction, mais les opérations intellectuelles propres à la philosophie dont il est capable au départ. A l’époque du cours classique, nous savions, par expérience, ce dont l’étudiant était capable, parce que nous savions ce qu’il avait appris dans ses humanités. Il avait moins de lacunes sémantiques, il possédait une certaine capacité d’analyse et de synthèse, et le professeur de philosophie pouvait compter sur une culture assez développée de l’étudiant.

Aujourd’hui, en raison de la réforme des programmes et des structures, nous ignorons, au début, qui est, sur le plan intellectuel, l’étudiant qui commence son cours collégial. Nous apprenons, en cours de route, et non d’une façon scientifique, qu’il est capable de retenir des connaissances et des explications, qu’il sait plus ou moins faire l’analyse morphologique et littéraire et qu’il souffre de graves déficiences sémantiques. Nous savons, d’autre part, et toujours d’une façon imprécise, qu’il est enclin à porter des jugements moraux et globaux sur les phénomènes qui l’entourent, qu’il a tendance à chercher ce que pense le professeur, et, d’une façon générale, que son apprentissage a été de type réceptif. Nous savons aussi que l’étudiant sent le besoin d’un professeur qui lui indique non seulement le contenu de ce qu’il doit apprendre, mais la façon dont il doit l’apprendre. Cependant, il n’existe aucune étude scientifique valable nous indiquant précisément le comportement de l’étudiant au point de vue intellectuel. Nous devrions commencer par là.

Il conviendrait de savoir, aussi, le degré d’efficacité des méthodes employées par les professeurs. Mais cela suppose que nous sachions ce qu’est la philosophie en termes d’activité mentale. Si nous voulons juger de l’efficacité d’une méthode, nous devons savoir, au départ, ce qu’elle doit provoquer comme changement, dans les opérations mentales des étudiants. Nous pourrons, ensuite, mesurer ce changement et juger de l’efficacité de telle ou telle méthode.

Il faut bien comprendre, cependant, qu’il ne s’agit pas ici, de méthode philosophique qui, elle, peut varier avec chaque professeur selon son option philosophique, mais bien d’une méthode didactique. Il se peut fort bien, par exemple, que les méthodes didactiques audio-visuelles aient une efficacité plus grande ou plus faible que celle que nous lui attribuons habituellement. Mais nous ne pouvons pas le savoir, tant que nous n’aurons pas déterminé les opérations propres à la philosophie, indépendamment des méthodes philosophiques, et que nous n’aurons pas mesuré les résultats de l’expérimentation de ces méthodes. Il existe très peu d’études scientifiques sur cette question primordiale.

Nous croyons qu’il faudrait s’orienter dans cette direction, si l’on veut aider à la solution des problèmes difficiles de l’enseignement de la philosophie.

[1] Les auteurs sont professeurs de philosophie au CÉGEP du Vieux-Montréal.

[2] voir François. GAGNÉ et Marie CHABOT, « PERPE, une conception neuve du perfectionnement pédagogique », dans Prospectives, Vol. 6, no 3, juin 1970.

[3] Nous avons fait une critique de ce Rapport dans l’Action nationale, avril 1971.

Source web : https://eduq.info/xmlui/bitstream/handle/11515/33443/collin-osana-7-5-1971.pdf

DOCUMENT DE RECHERCHE AUQUEL SE RÉFÈRE CLAUDE COLLIN

TRANSCRIPTION INTÉGRALE

Source : Prospectives, Vol. 6, No 3, Juin 1970

PERPE, une conception neuve du perfectionnement pédagogique

par Françoys GAGNÉ et Marie CHABOT

PARTIE 1

Depuis plus de trois ans, une équipe de chercheurs travaille à la construction d’un instrument scientifique d’évaluation des cours, basé sur les perceptions des étudiants. Nous avons baptisé cet instrument « test PERPE » (Perceptions Étudiantes de la Relation Professeur-Étudiants).

Conçu dans le cadre des loisirs de l’un de nous, à l’époque professeur de psychologie au Collège Sainte-Croix, nourri du dévouement d’une bonne demi-douzaine de ses étudiants de Philo II, le projet PERPE a rapidement pris de l’ampleur grâce à de généreux octrois de la Direction générale de l’enseignement collégial (DIGEC) et à l’appui inconditionnel du Service d’informatique du ministère de l’Éducation (SIMEQ).

Au terme de ces trois années d’expérimentation, le test PERPE peut être considéré techniquement au point et prêt à servir. Lorsque mis en service à l’échelle du réseau collégial, il constituera le premier chaînon d’un vaste système de perfectionnement pédagogique axé sur l’évaluation par les étudiants. Dans les pages qui suivent, nous tenterons de décrire ce système en montrant comment il s’insère dans la réalité quotidienne du professeur et de l’étudiant.

Un instrument détaillé

1. Les dimensions du test

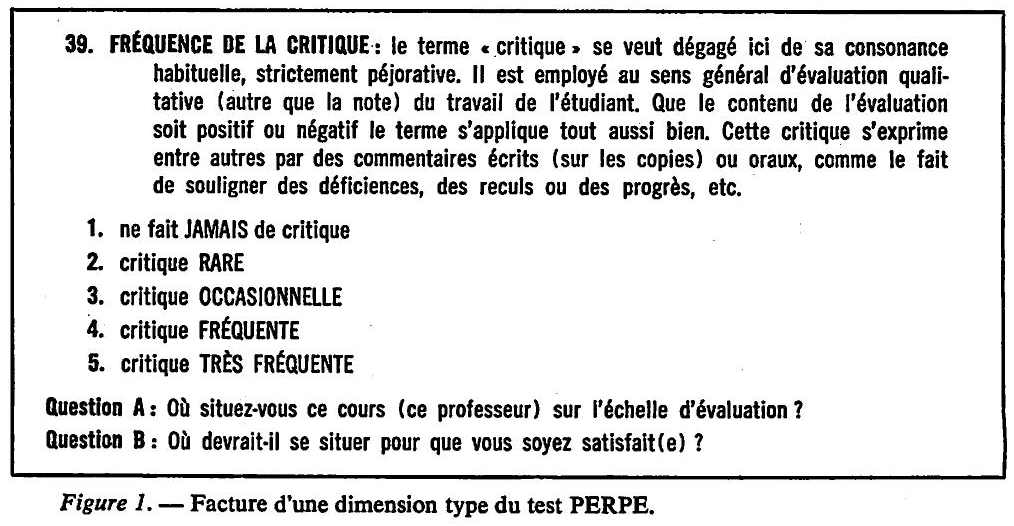

Le test PERPE est composé de 61 dimensions. Chacune rejoint un aspect différent de la a situation d’enseignement 3. Dans la mesure du possible, la dimension est définie opérationnellement, c’est-A-dire A l’aide d’exemples concrets de comportements ou d’événements (fig. 1). Si cette technique allonge considérablement le temps de lecture, elle facilite d’autre part une compréhension univoque par le groupe étudiant du sens précis de la réalité à évalue

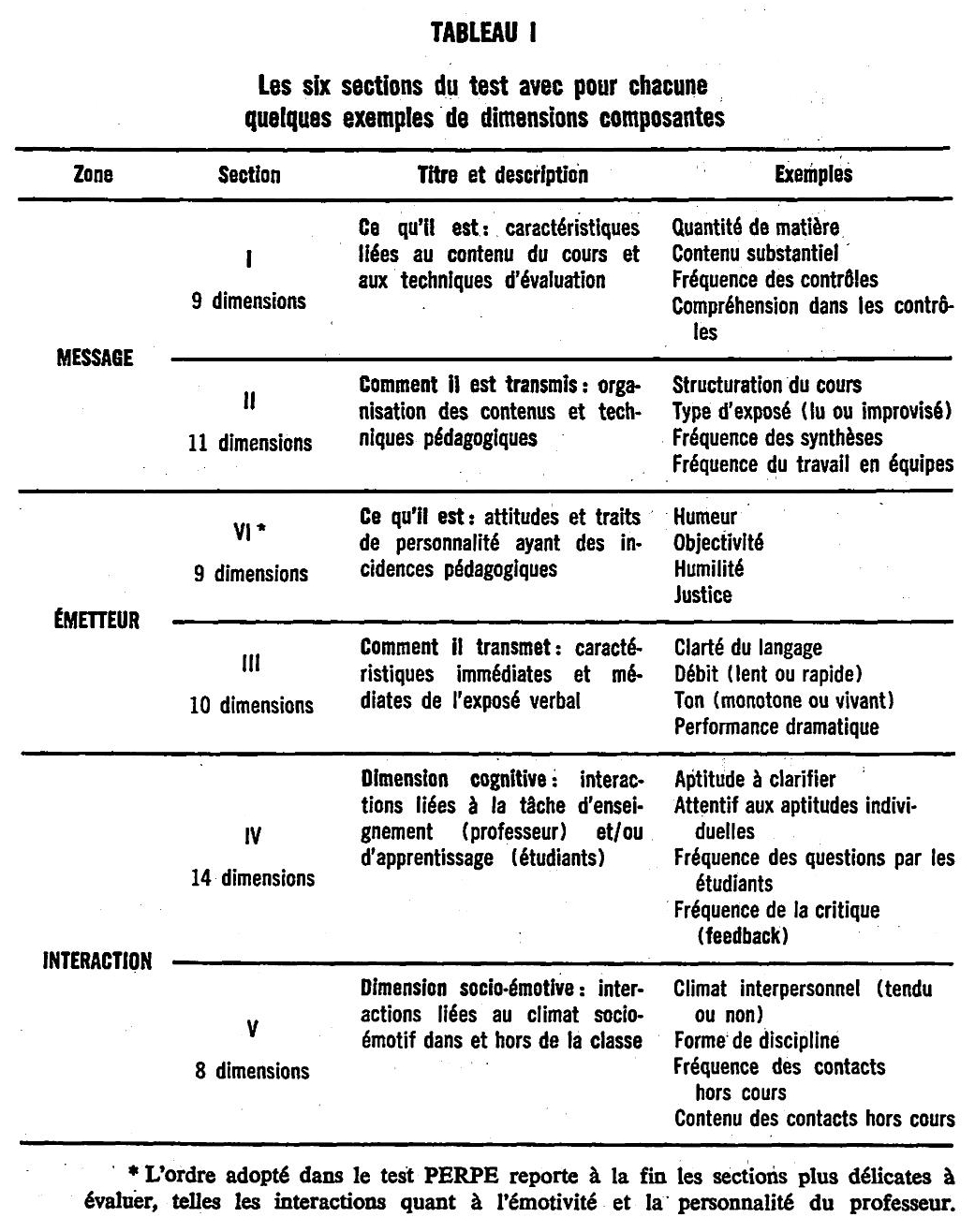

Les 61 dimensions du test PERPE peuvent être regroupées de diverses façons dans le but de constituer des sections 3 relativement homogènes. Nous avons pu nous-mêmes constater que les formes de regroupements variaient sensiblement selon le modèle ou la conception que chaque juge se faisait de la a situation d’enseignement 3. Vous trouverez dans le tableau 1, toute discutable qu’elle soit, la plus récente de nos tentatives. En outre, pour fournir une meilleure image du contenu du test PERPE, ce même tableau donne quelques titres de dimensions caractéristiques de chaque section. il faut bien se rappeler B la lecture de ces titres que chacun est accompagné d’une description opérationnelle qui clarifie le sens précis du titre.

2. La technique d’évaluation

Tel que le montre la figure 1, chaque dimension est composée:

- d’un titre en majuscules;

- d’une description détaillée de la réalité que nous entendons mesurer;

- d’une échelle d’évaluation en cinq points où chaque point est décrit;

- de deux questions, dont l’une (question A) mesure les perceptions étudiantes

- de la réalité et l’autre (question B) leurs attentes face à cette réalité.

En guise de réponse à ces deux questions, l’étudiant doit indiquer quel point de l’échelle d’évaluation correspond le mieux, soit à sa perception de la réalité (question A), soit à ses attentes (question B). L’étudiant inscrit sur une feuille de réponses spécialement construite pour le transfert mécanographique les valeurs numériques qui correspondent à ses choix.

Au total, l’étudiant doit effectuer 122 choix. Ce travail exige en moyenne de 30 à 40 minutes, lorsque le sujet en est à sa première utilisation de l’instrument. Ainsi, en incluant le temps réservé à la lecture des directives, l’administration du test PERPE s’insère aisément à l’intérieur d’une période de cours de 50 minutes.

3. Trois mesures fondamentales

Les mesures de réalité, d’attentes et d’insatisfaction constituent la base des informations recueillies au niveau de chaque dimension. Dans chacun des trois cas, il s’agit de moyennes basées sur les réponses de tous les étudiants du groupe.

Les mesures de réalité et d’attentes correspondent respectivement aux moyennes des réponses aux questions A et B qui accompagnent chaque dimension. En ce qui concerne la mesure d’insatisfaction, nous basons son calcul sur un postulat fondamental que nous pouvons formuler comme suit : Toute différence entre les valeurs numériques données à une réponse A et à une réponse B doit être considérée comme indicative d’une insatisfaction chez l’étudiant.

De ce postulat découlent deux corollaires:

a) Toute absence de différence entre les valeurs numériques données à une réponse A et à une réponse B doit être considérée comme indicative de satisfaction chez l’étudiant.

b) Plus grande est la différence entre les valeurs numériques des réponses A et B, plus grande est l’insatisfaction ; plus faible est la différence entre ces deux valeurs numériques, plus faible est l’insatisfaction.Bref, pour mesurer le degré de satisfaction d’un étudiant (ou d’un groupe d’étudiants), il suffit de mesurer l’écart entre son évaluation de la réalité et celle de ses attentes : plus grand sera cet écart, plus il sera jugé insatisfait. Notons immédiatement que ces différences peuvent être positives ($A>B$) ou négatives ($A<B$). Le signe algébrique de la différence indique le SENS de cette insatisfaction. Une différence positive signalera habituellement un SURCROÎT (quantité TROP grande de matière, débit TROP rapide, etc.), tandis qu’une différence négative indiquera une CARENCE (contenu TROP PEU captivant, critique TROP rare, etc.). Nous verrons plus bas comment le professeur utilise ces informations pour tracer le portrait de son enseignement tel qu’il est perçu par ses étudiants.

Les étudiants, principaux collaborateurs de PERPE

C’est à un double titre que nous pouvons considérer les étudiants comme les principaux collaborateurs de PERPE. C’est d’abord eux que nous avons choisis, de préférence à tout autre, comme sujets percevant, comme instruments de feedback de l’enseignement donné par le professeur. Le fait d’être témoins quotidiens de l’enseignement donné par le professeur leur confère en effet un statut d’observateurs « privilégiés ».

En second lieu, à cause de leur rôle de premier plan dans le projet PERPE, nous avons tenu à les intégrer aux premières phases de construction de l’instrument, nommément l’identification des dimensions pertinentes pour l’évaluation du cours et du professeur. Ainsi, le test PERPE débuta dans le cadre de travaux d’étudiants pour un cours de psychologie sociale du niveau du baccalauréat. Dans le but de clarifier les critères selon lesquels les étudiants évaluaient leurs cours, ces derniers entreprirent d’observer leurs professeurs et de noter les comportements jugés importants pour une appréciation du cours. La première forme expérimentale de PERPE (forme A) fut construite à partir d’un regroupement de plus de 600 de ces fiches descriptives. Malgré les transformations apportées au test entre les formes A et F, 37 des dimensions originelles furent conservées dans la forme finale. Bref, par le principe même de leur construction, nous avons pu nous assurer que les dimensions se situent dans le système de référence des personnes qui les utilisent en tant qu’évaluateurs.

Le recours aux étudiants comme évaluateurs pose un problème majeur : celui de leur objectivité. Un premier indice positif de cette objectivité nous est venu des professeurs eux-mêmes. Rejoints lors d’entrevues de relance (follow-up) et par sondage écrit, une infime minorité d’entre eux ont mis en doute l’objectivité des étudiants et ce, sur quelques points seulement de leur dossier.

Insatisfaits de ce témoignage, nous avons tenté de vérifier plus scientifiquement ce phénomène par une mise en relation de certaines caractéristiques personnelles des étudiants avec leur façon d’évaluer le cours et le professeur. Il s’avère que la satisfaction exprimée par un étudiant à l’égard de son professeur n’a aucun lien avec son succès dans la matière enseignée par ce professeur, non plus qu’avec sa réussite moyenne dans l’ensemble des cours. La variable âge n’intervient pas non plus. Seul le sexe de l’étudiant peut être considéré comme facteur pouvant influencer les résultats ; ainsi, les filles auraient une légère tendance, sur certaines dimensions, à situer la réalité ou leurs attentes un peu plus haut que les garçons.

Enfin, à l’aide de questionnaires présentés en même temps que les formes A, C, D et F, nous avons pu constater que les étudiants évaluent l’importance relative des dimensions de façon semblable à celle des professeurs, ce qui confirme davantage le crédit qu’il faut accorder à leur jugement.

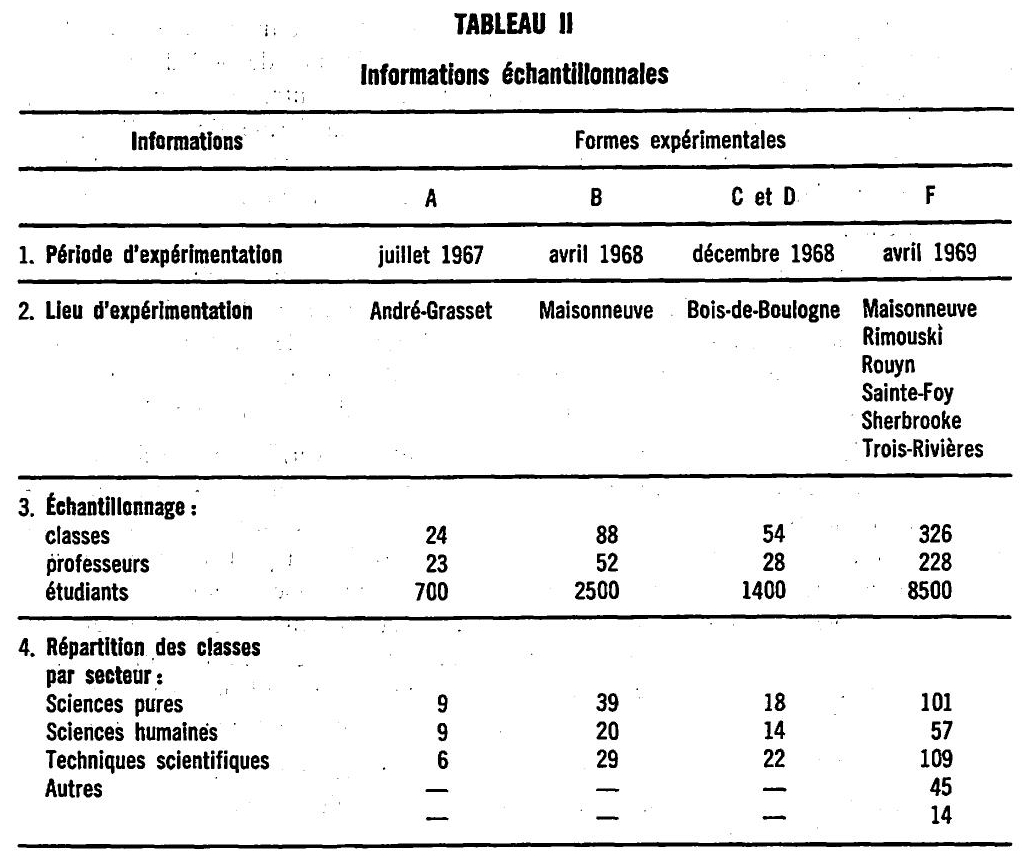

Un instrument scientifique

Ainsi que nous l’avons déjà souligné, il a fallu plus de trois années de travaux scientifiques pour construire le test PERPE. Durant cette période, près d’une vingtaine de spécialistes (chercheurs, statisticiens, stagiaires universitaires) ont collaboré à la mise au point de l’instrument. Quelques statistiques globales donneront une idée de l’envergure de ce projet : nous avons administré cinq formes différentes du test PERPE à plus de 13 000 étudiants, dans 500 classes, avec la collaboration de 330 professeurs. Huit collèges ont collaboré aux diverses étapes expérimentales. Le tableau II résume pour chacune des expérimentations effectuées les principales statistiques descriptives concernant les échantillons réunis.

Chaque expérimentation répondait à des objectifs précis. La première n’avait pour but que de sonder la valeur de l’approche méthodologique utilisée. La seconde (forme B) visait à recueillir une foule d’informations statistiques sur chacune des 61 dimensions. Au cours de l’été suivant, nous avons soumis chaque dimension à une critique serrée au plan psychométrique. L’expérimentation de cette forme finale (forme F) avait pour objectif la normalisation du test, tant sur une base provinciale que pour chacun des secteurs.

Nous avons pu contrôler la valeur scientifique de notre instrument par l’intermédiaire de trois séries d’études portant respectivement sur les qualités techniques de chaque dimension, sur la fidélité des mesures et sur la validité des résultats.

1. Sélection des dimensions

N’entre pas qui veut dans le « club » des 61 dimensions de PERPE ! Avant d’être intégrées à la forme finale du test, toutes les dimensions expérimentées, soit 97, ont subi de multiples contrôles statistiques. De fait, notre jugement quant à la valeur d’une dimension s’appuyait sur une bonne dizaine de critères.

Ainsi, il importait avant tout qu’une dimension suscite une certaine dose minimum d’insatisfaction ; sinon, c’est-à-dire lorsque l’ensemble des professeurs étaient jugés très satisfaisants, la dimension perdait tout intérêt au plan du diagnostic. Mais ce n’est pas tout. Nous attendions de plus une bonne dispersion des professeurs, tant au plan des mesures de réalité que des mesures d’insatisfaction. Cette dispersion interclasses des mesures garantit une meilleure discrimination de l’instrument et, par voie de conséquence, des profils vraiment différentiels.

Corrélativement à cette recherche d’une forte dispersion entre les cours évalués, nous exigions que la dimension choisie donne lieu à une bonne cohésion des évaluations effectuées par les membres d’une même classe : les mesures de réalité devaient se concentrer le plus possible autour d’un point de l’échelle d’évaluation. Ce ne sont là que quelques-uns des contrôles statistiques auxquels nous soumettions chaque dimension expérimentée et ce, chaque fois qu’elle se trouvait incluse dans une forme expérimentale. Grâce à ces contrôles, 36 des 97 dimensions mises à l’essai ont dû être abandonnées, tandis que plus de la moitié des 61 dimensions restantes subissaient, à la lumière des informations recueillies, des transformations plus ou moins grandes, soit au plan du texte descriptif ou à celui de l’échelle d’évaluation.

2. Fidélité des mesures

La fidélité d’un instrument d’évaluation correspond à la stabilité dans le temps des mesures enregistrées. Si l’on ne peut exiger d’un instrument de ce type une stabilité à long terme, il faut cependant avoir l’assurance que les résultats de l’évaluation d’un cours par un groupe d’étudiants ne fluctueront pas sensiblement à l’intérieur d’un décalage de quelques semaines. Plusieurs techniques existent pour vérifier cette stabilité des mesures. Nous n’avons pu utiliser jusqu’ici la technique classique du test-retest, consistant en deux administrations successives à un même groupe avec décalage temporel entre les deux. Cependant, deux techniques équivalentes ont donné des résultats plus que satisfaisants.

La première consistait à scinder les classes en deux sous-groupes et à comparer les résultats obtenus dans chacun des sous-groupes. Ces calculs ont confirmé qu’un groupe de quinze évaluateurs suffisait à tracer un portrait relativement stable de l’enseignement donné par un professeur. Comme second type de vérification de la fidélité de l’instrument, nous avons comparé les résultats de l’évaluation d’un même professeur par deux groupes différents d’étudiants. Malgré la sévérité d’une telle technique, nous avons constaté (avec plaisir) que les deux profils d’un même professeur, obtenus par deux groupes indépendants, se ressemblaient dans 8 cas sur 10 plus étroitement que n’importe quelle comparaison de profils de deux professeurs différents.

3. La validité du test

Enfin, pour nous assurer de la validité d’un test, nous devons pouvoir démontrer logiquement ou vérifier statistiquement qu’il mesure effectivement ce qu’il prétend mesurer. Or, dans le cas de PERPE, notre principal souci fut de voir à ce que les dimensions représentent adéquatement la relation professeur-étudiant.

Le recours aux étudiants lors de la première construction des dimensions eut pour effet d’ancrer le test dans la réalité concrète de l’actuel enseignement collégial. En 1968 et en 1969, deux enquêtes menées auprès des professeurs qui avaient utilisé PERPE permirent de confirmer la capacité du test à vraiment rendre compte de la réalité pédagogique. En 1968, l’attitude de 92% des répondants face au test était « positive » ou « très positive », tandis qu’en 1969, 96% d’entre eux jugeaient l’expérience « enrichissante » ou « intéressante ». Le meilleur témoignage que nous ayons de l’articulation du test avec la réalité réside dans le fait que 79% (1968) et 84% (1969) des professeurs affirment avoir pris en note une ou quelques dimensions dont le résultat était plus faible dans le but exprès de travailler à les « corriger ».

À l’heure actuelle, les seules limites du contenu qu’il faille souligner sont les suivantes : tout d’abord les aspects spécifiques à l’enseignement de telle ou telle matière ne sont pas évalués, parce que les dimensions retenues sont destinées à une utilisation générale. Deuxièmement, PERPE n’évalue pas en détail dans sa forme actuelle les nouvelles méthodologies de travail (travaux d’équipe, séminaires, cours programmés, recherches ou stages), parce que ces approches pédagogiques sont encore peu fréquentes dans le réseau.

Au delà de l’aptitude du contenu à refléter adéquatement la situation habituelle d’enseignement, nous devons pouvoir vérifier si nos « concepts » explicatifs sont valides. La notion d’insatisfaction est centrale à l’interprétation de plusieurs des résultats et c’est le score d’insatisfaction (MAL) qui sert d’indice pour toutes les comparaisons entre professeurs.

Dans quelle mesure le terme est-il bien choisi ? Nous avons vu plus haut que plus la MAL (insatisfaction) est petite, plus la MA (évaluation du comportement) et la MB (attentes des étudiants) sont rapprochées. La question qui se pose est la suivante : est-il possible que les professeurs jugés satisfaisants (MAL plus petite) aient tout simplement des étudiants beaucoup moins exigeants (MB plus basses), qui, à comportement égal, ne les font que paraître plus satisfaisants ?

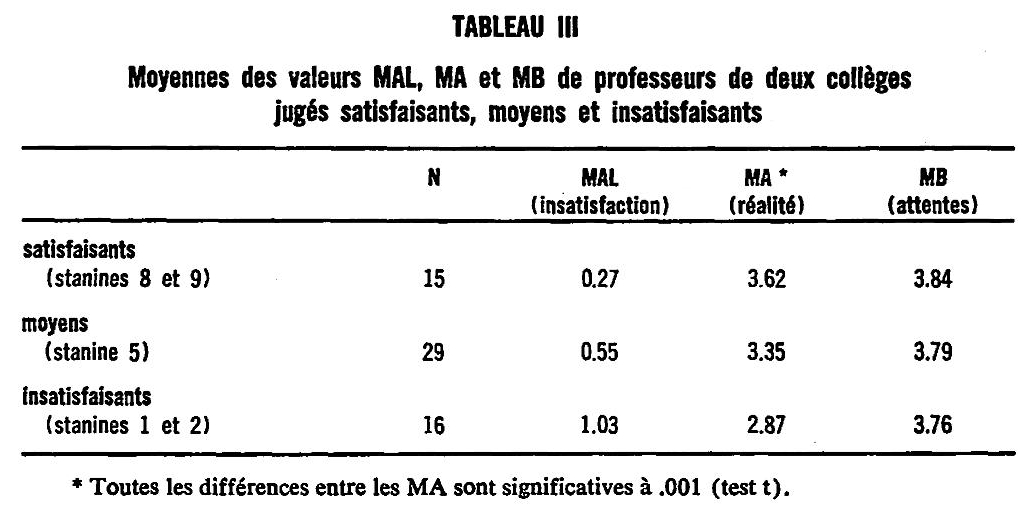

La comparaison de professeurs de deux collèges de l’échantillon F (1969), clairement identifiés comme satisfaisants (stanines 8 et 9), moyens (stanine 5) et insatisfaisants (stanines 1 et 2), nous permet de rejeter cette possibilité. Les MAL, MA et MB de ces professeurs sont présentées au tableau III.

Même à l’œil, il est facile de reconnaître que les fluctuations des MAL sont accompagnées de fluctuations des MA, tandis que les MB demeurent assez stables. Ainsi, les attentes des étudiants varient peu dans l’ensemble, et les différences entre les trois groupes de professeurs sont attribuables uniquement à des différences dans l’évaluation de leur comportement. Les professeurs satisfaisants sont même pénalisés en quelque sorte : non seulement ont-ils une évaluation MA plus élevée ($MA = 3.62$), mais ils ont à rencontrer des attentes plus exigeantes ($MB = 3.84$) que celles qui ont été fixées à leurs collègues jugés insatisfaisants !

Conçu essentiellement comme outil de diagnostic

Le dossier individuel

Le dossier que reçoit le professeur comprend cinq documents :

- l’histogramme de la distribution des étudiants de la classe ;

- un guide d’analyse de l’histogramme ;

- le dossier mécanographique des résultats de la classe ;

- un guide d’analyse du dossier mécanographique ;

- une copie du test PERPE.

1. L’histogramme de la classe

1. L’histogramme de la classe

L’histogramme de la distribution des étudiants est un graphique, compilé et

imprimé par l’ordinateur, qui permet de voir comment s’échelonnent les moyennes individuelles d’insatisfaction des étudiants d’une classe. Plus grande est la dispersion de ces cotes individuelles, plus le degré d’insatisfaction varie d’un étudiant à l’autre.

Lorsqu’un ou quelques étudiants sont isolés du reste du groupe par une différence de .40 ou plus dans leur moyenne d’insatisfaction, l’ordinateur les élimine de l’échantillon. Ces c cas marginaux B sont jugés comme étant non représentatifs de la classe et comme susceptibles de fausser tous les calculs.

Voici la transcription fidèle et intégrale des pages 170 à 172 du document de Françoys Gagné et Marie Chabot (1970).

2. Le dossier mécanographique

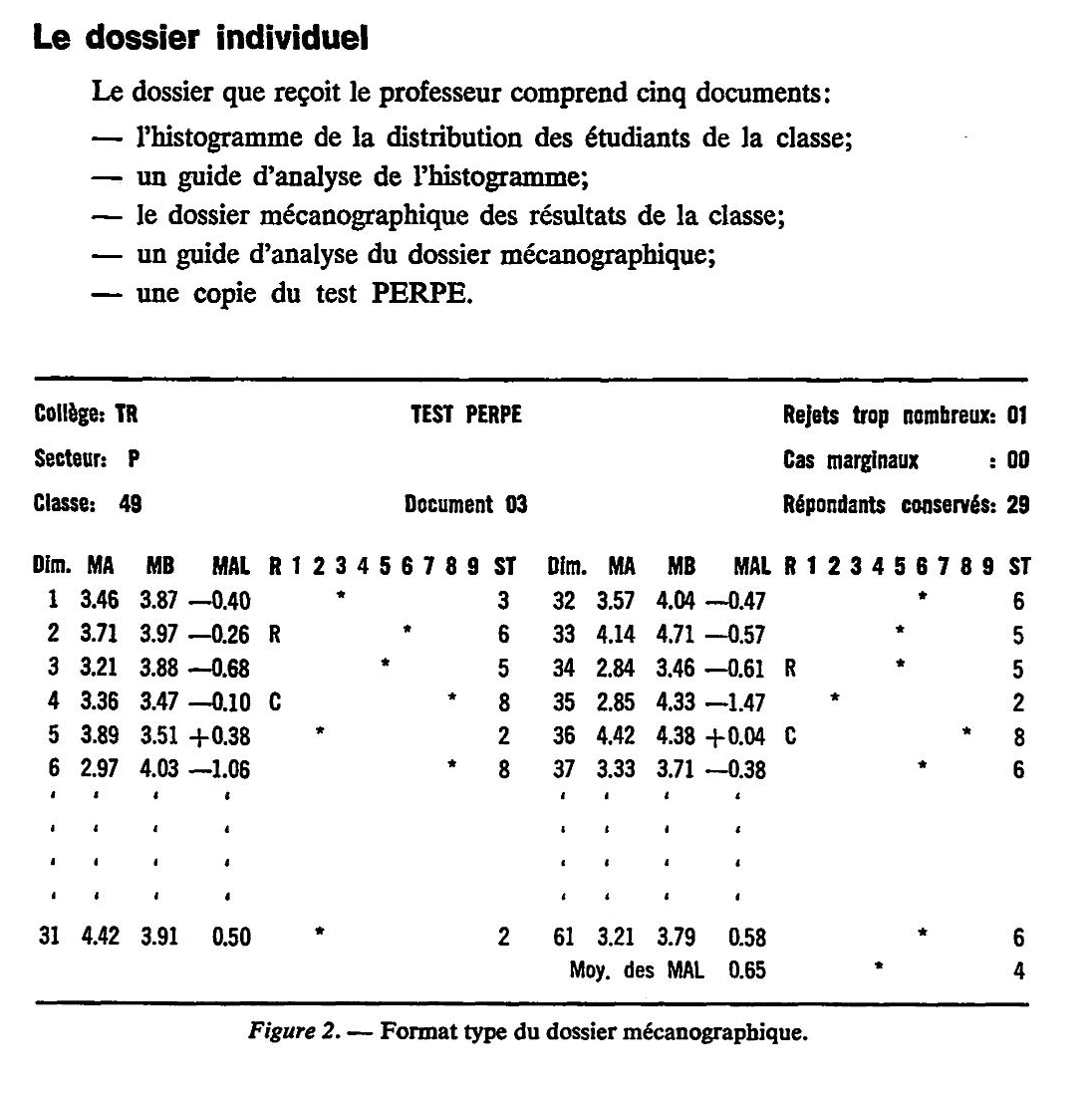

Second document produit par l’ordinateur, le dossier mécanographique réunit toutes les données présentées au professeur. La figure 2 illustre le format-type de ce dossier. Un premier groupe d’informations administratives permet d’identifier :

- le CEGEP;

- le secteur du groupe étudiant (général, professionnel ou mixte);

- la classe;

- le nombre d’étudiants dans la classe.

Un second groupe d’informations est lié au contrôle de la qualité. Ces informations comprennent :

- le nombre d’étudiants exclus des compilations pour avoir répondu à un nombre insuffisant de questions;

- le nombre des cas marginaux;

- l’identification par la lettre R des dimensions où plus de 25% des étudiants se sont abstenus de répondre;

- l’identification par la lettre C des dimensions où les étudiants de la classe ne s’entendaient pas suffisamment sur le SENS de leur insatisfaction.

Les résultats eux-mêmes constituent le troisième groupe d’information. De façon succincte, ces résultats sont les suivants :

a) Pour chacune des 61 dimensions :

- la MA, ou moyenne des réponses à la question A portant sur l’évaluation de la réalité;

- la MB, ou moyenne des réponses à la question B portant sur l’évaluation des attentes;

- la MAL, ou moyenne algébrique des cotes d’insatisfaction;

- le stanine, c’est-à-dire un chiffre entre 1 et 9 indiquant au professeur comment sa MAL se situe, pour la dimension en question, à l’intérieur d’une classification en 9 groupes de tous les professeurs de son CEGEP.

La représentation graphique des stanines (fig. 2), au moyen d’astérisques situés dans l’une de neuf colonnes, fournit au professeur le profil des 61 comparaisons avec l’ensemble des professeurs. Ce profil permet au professeur d’identifier rapidement ses forces (stanines 7, 8 et 9) et ses faiblesses (stanines 1, 2 et 3).

b) Pour l’ensemble des 61 dimensions :

- la MAL globale, basée sur le cumul des cotes individuelles d’insatisfaction (MAL);

- le stanine global du professeur, basé sur la répartition en 9 catégories des MAL globales de tous les professeurs du CEGEP.

Le diagnostic social

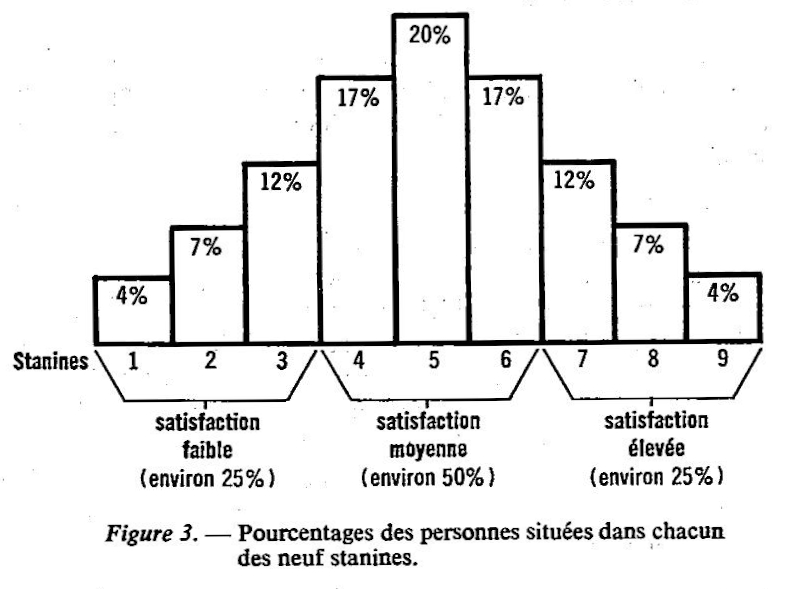

La comparaison des professeurs entre eux permet aux individus de se situer de façon précise à l’intérieur d’un groupe de référence. Nous avons adopté, tel que décrit ci-haut, une classification en 9 catégories ou stanines. La figure 3 permet de constater que chaque stanine correspond à un pourcentage précis de professeurs.

(Le graphique montre une distribution normale où les stanines 1 et 9 représentent 4%, les stanines 2 et 8 représentent 7%, les stanines 3 et 7 représentent 12%, les stanines 4 et 6 représentent 17%, et le stanine 5 représente 20% de la population.)

(Le graphique montre une distribution normale où les stanines 1 et 9 représentent 4%, les stanines 2 et 8 représentent 7%, les stanines 3 et 7 représentent 12%, les stanines 4 et 6 représentent 17%, et le stanine 5 représente 20% de la population.)

Le professeur qui veut un diagnostic social rapide sait, par exemple, qu’un stanine 7, 8 ou 9 le situe dans le quart supérieur de ce groupe. S’il veut un diagnostic social plus précis, il peut examiner les pourcentages exacts de chacune des neuf catégories. Il saura ainsi qu’un stanine 9 signifie qu’il est jugé plus satisfaisant que 96% de ses collègues et qu’un stanine 2 veut dire qu’il est jugé moins satisfaisant que 89% de ses collègues.

Ce type d’information permet d’envisager un résultat individuel de façon plus relative : une cote d’insatisfaction (MAL) peut être plutôt petite mais se situer quand même dans le tiers inférieur par rapport au groupe; le professeur saura ainsi qu’il doit quand même travailler à améliorer ce point. À l’inverse, une MAL assez forte peut se situer dans le tiers supérieur du groupe s’il s’agit d’une dimension qui crée une insatisfaction généralisée à l’ensemble du groupe de référence. C’est le cas, par exemple, de la dimension 18 (utilisation du matériel didactique) pour laquelle les MAL sont toutes très fortes. Les stanines permettent de comparer les individus entre eux selon différents modes de regroupement : les professeurs du réseau collégial, ceux du même CEGEP ou du même secteur. Jusqu’ici le dossier n’a offert aux professeurs que la comparaison entre les professeurs d’un même CEGEP. Après enquête, PERPE a choisi de systématiser l’utilisation de deux groupes de référence : le réseau et le secteur. À compter de l’automne 1970, les dossiers individuels présenteront simultanément ces deux profils de stanines.

Le caractère stimulant de ces comparaisons va de soi! Signalons toutefois que le professeur favorisé par la classification en stanines (diagnostic social) trouve toujours malgré cela une ou des dimensions de son dossier plus faibles que les autres, dimensions qu’il devra améliorer. Pour le professeur moins avantagé et dont le faible dossier entame son amour-propre, le contraire se produira : il trouvera le plus souvent quelques points forts que ses étudiants auront reconnus. D’ailleurs deux aspects du test sont un réconfort pour le professeur déçu de ses résultats : tout d’abord, le dossier demeure confidentiel et par conséquent ne contient pas de menace externe; en second lieu, il a des informations précises sur ses difficultés, ce qui est déjà un pas de fait vers le renouvellement de son enseignement.

Le diagnostic personnel

Malgré le caractère attirant du profil en stanines et la stimulation produite par le diagnostic social, ce dernier n’en est pas moins incomplet. En effet, le dossier contient une foule d’informations additionnelles dont l’étude procure un profit indiscutable.

L’examen des MA, notamment, fournit au professeur une idée précise de l’évaluation de ses comportements et de ses attitudes, si toutefois il entreprend de se référer constamment aux échelles descriptives du questionnaire. Ce travail d’analyse est indispensable pour bénéficier pleinement des résultats, car les moyennes ont des significations bien diverses selon la graduation en intensité des points de chaque échelle. De plus, au delà de cette prise de conscience de soi « moléculaire », dimension par dimension, le professeur est à même d’identifier les familles de dimensions pour lesquelles son évaluation est la même.

Mais c’est l’étude des attentes (MB) qui ouvre les perspectives les plus nouvelles. Le professeur peut ainsi découvrir ce que ses étudiants souhaitent réellement. Ces attentes constituent pour lui des objectifs pédagogiques dont la réalisation devrait normalement accroître l’efficience de son enseignement.

Enfin, l’étude des moyennes d’insatisfaction (MAL) permet de hiérarchiser les besoins de changement. Plus la MAL est élevée, plus le besoin de correction est pressant aux yeux des étudiants. Ce diagnostic personnel est le prélude nécessaire à toute démarche de perfectionnement.

Pour l’avenir, une batterie d’instruments d’évaluation

Des PERPE spécifiques

Dans les pages qui précèdent, nous n’avons décrit que les possibilités actualisées du test PERPE. Si nous faisons un bref retour sur ce qui a été dit, nous nous apercevons que l’utilisation de l’étudiant, le détail de l’instrument et de ses mesures, le dossier et la normalisation selon divers groupes de références, sont des caractéristiques de la structure du test.

Ces caractéristiques agissent dans leur ensemble comme le contenant des dimensions, et les seules limites de PERPE, c’est-à-dire les limites du diagnostic qu’il permet de poser, proviennent des limites du contenu lui-même ; le répertoire des dimensions circonscrit d’avance le type d’informations que pourront fournir les résultats. Toutefois, ce répertoire est interchangeable, comme nous avons pu le constater lors de l’expérimentation, en décembre 1969, d’une version spécialisée du test appelée PERPE-PHILO. Si le PERPE général est applicable à tout cours, il ne peut toutefois rien mesurer qui soit spécifique à une matière en particulier. Le PERPE-PHILO comble cette lacune au moyen d’un ensemble de dimensions spécialement pertinentes à l’enseignement de la philosophie. Voici, à titre d’exemple, quelques dimensions de cet instrument : 18. Correspondance du contenu à l’expérience vécue ; 23. Initiation au vocabulaire philosophique ; 60. Rôle unificateur au plan parascolaire ; etc.

Bien que l’expérimentation n’ait porté que sur 56 classes, le soin donné à la composition de cet échantillon fut bien récompensé : entre 28 classes du cours de philosophie 101 et 28 classes du cours 301, de nettes différences sont apparues quant au type d’insatisfaction exprimé par chacun des deux groupes. D’autre part, le découpage par sections des 61 dimensions du PERPE-PHILO permet aussi de repérer les forces et les faiblesses de l’actuel enseignement de la philosophie.

Les bénéfices de l’expérimentation PERPE-PHILO furent assez clairs pour qu’une administration beaucoup plus vaste, à l’échelle du réseau, soit envisagée par les membres du comité provincial de Philosophie pour l’automne 1970.

Avec cet instrument, la voie est tracée pour d’autres PERPE spécifiques : PERPE-HISTOIRE, PERPE-BIOLOGIE, PERPE-SCIENCES SOCIALES, etc., selon les besoins du milieu. De tels projets requièrent, non pas les trois années qui ont servi à mettre PERPE au point, mais tout au plus le dégagement à temps plein d’un professeur de la discipline concernée pendant une session. Une fois le questionnaire monté, le service PERPE peut assumer la marche des opérations et des analyses.

Vers un PERPE « modulaire »

Les techniques pédagogiques non magistrales sont un autre aspect de l’enseignement que l’actuel PERPE ne mesure pas. Le travail en équipes (dim. 17) et l’utilisation des moyens audio-visuels (dim. 18) sont bien évalués quant à leur fréquence, mais le détail ou les modalités de ces nouvelles approches pédagogiques ne sont pas explorés. Ici encore, la destination généralisée de PERPE fut un facteur déterminant du choix des dimensions. Malheureusement certains des professeurs les plus désireux d’utiliser PERPE sont justement ceux qui aimeraient évaluer, à la fin d’un cours, la satisfaction des étudiants quant aux innovations pédagogiques.

Pour répondre à leurs attentes, nous aimerions construire un certain nombre de dimensions destinées à rejoindre tous ces courants nouveaux de la pédagogie au collégial. Mais alors, pour les intégrer au test PERPE, sans avoir à repenser complètement notre système de traitement mécanographique, il faudrait sacrifier un nombre correspondant de dimensions actuelles. Nous avons commencé à explorer diverses solutions à ce problème. Le projet à long terme qui nous apparaît le plus alléchant est celui d’un PERPE « modulaire ». L’ensemble des dimensions valides serait découpé en une dizaine de sections ou « modules » de même longueur.

Le professeur composerait alors lui-même SON test d’évaluation en choisissant les cinq ou six sections qui correspondent le mieux à ses propres besoins d’information sur son activité pédagogique. Mais tout cela n’est pas pour demain !

Voici la transcription fidèle et « arrangée » (mise en forme) du texte de la page 175 que vous avez soumis, en corrigeant les erreurs de lecture optique (OCR) pour rétablir les mots originaux (ex: actualisées au lieu de actualkées, vis-à-vis au lieu de *-&-vis, etc.) :

Du diagnostic au perfectionnement

Utilisation personnelle des résultats

L’idée de perfectionnement implique par définition un changement, une transformation. Quelle assurance avons-nous du dépassement de la valeur diagnostique de PERPE et de son prolongement dans une action réellement dynamique sur la personne ? Dans quelle mesure le professeur qui examine son dossier, qui y trouve, comme nous l’avons montré, un diagnostic personnel et un diagnostic social, ne mettra-t-il pas ses résultats dans un tiroir, tout simplement, pour ne plus y penser ?

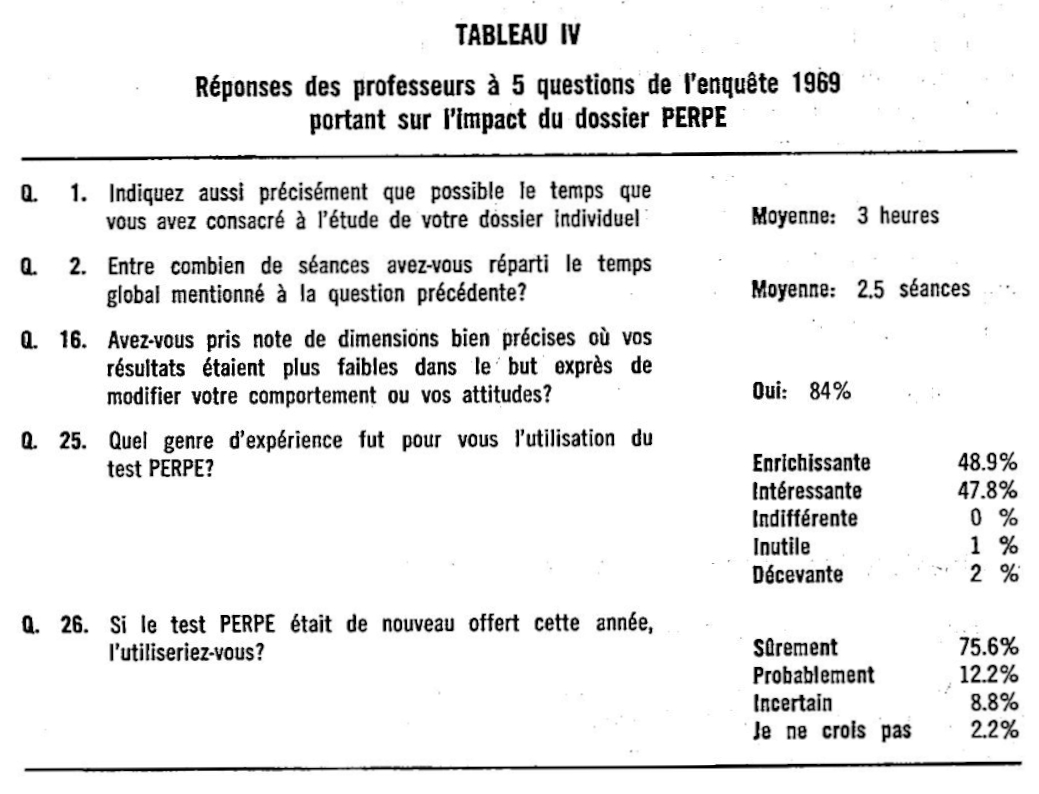

Notre première réponse à cette question provient du sondage mené en 1969 auprès des 228 professeurs qui avaient utilisé PERPE. Une centaine d’entre eux y ont répondu et nous ont permis d’analyser leurs réactions vis-à-vis du test. Nous présentons au tableau 4 leurs réponses à 5 questions concernant l’impact du dossier PERPE. Ce tableau nous permet de voir que les professeurs n’envisagent pas leur dossier à la légère (Q. 1 et 2), puisqu’ils prennent pour l’étudier 3 heures, en moyenne, réparties sur 2 ou 3 séances (certains d’entre eux l’ont même étudié durant 8 à 9 heures !). En réponse à la question 16, 84% affirment avoir noté des résultats plus faibles dans le but de modifier leur comportement ou leurs attitudes, tandis que dans l’ensemble (Q. 25) l’utilisation du test fut une expérience ENRICHISSANTE ou INTÉRESSANTE pour 96% d’entre eux. En fin de compte, 88% des répondants réutiliseraient SÛREMENT ou PROBABLEMENT le test PERPE.

Ces témoignages nous permettent de vérifier que PERPE agit effectivement comme agent de perfectionnement. Mais comment pouvons-nous l’expliquer ? À nos yeux, deux facteurs rendent compte surtout de l’intérêt accordé aux résultats du test : la provenance sociale ou interpersonnelle des résultats et le climat fondamentalement non directif qui entoure l’évaluation.

Puisqu’ils proviennent des réponses des étudiants, les résultats ont une origine interpersonnelle par opposition, par exemple, à des profils d’intérêts ou d’attitudes, fondés sur les réponses d’un sujet à un questionnaire qu’il remplit lui-même. Or, il est bien établi que la perception d’autrui sur soi-même constitue un puissant moteur d’une perception renouvelée de soi et d’une transformation personnelle.

Nous ne voulons pas nous engager ici dans la voie d’un exposé théorique du pourquoi et du comment de ce phénomène. Qu’il suffise de rappeler au lecteur l’expansion considérable des techniques de groupe dans notre milieu et la fécondité, maintes fois vérifiée par plusieurs d’entre nous, d’une prise de conscience de soi provenant de l’interaction avec autrui. Il semble donc que le dossier PERPE, bénéficiant de son enracinement social, ait au départ toutes les chances de ne pas laisser le professeur indifférent et d’agir sur lui comme une information qu’on ne peut négliger.

Un second facteur explicatif, tout aussi important que le premier, consisterait dans le climat qui entoure l’utilisation du test PERPE. Ce climat se définit par les notions suivantes : confidentialité et liberté. Le professeur est identifié au départ par un code alpha-numérique ; seul ce code accompagne ses résultats dans leur acheminement au ministère de l’Éducation pour fins de traitement des données. D’autre part, le CEGEP qui autorise l’utilisation du test par son personnel s’engage à ne pas demander au service PERPE, non plus qu’au professeur lui-même, copie du dossier personnel. La confidentialité du test, systématisée de la sorte, écarte toute « menace administrative ». Assuré que ses étudiants n’agiront pas sur sa promotion ou son réengagement, le professeur a tout à gagner en les utilisant pour une réévaluation honnête et non défensive de lui-même.

Le terme liberté, mentionné plus haut comme deuxième caractéristique du climat qui entoure le test, symbolise le caractère facultatif du service offert aux professeurs. Celui-ci ne passe pas le test sur commande, mais il en fait lui-même la demande, selon ses besoins personnels. Ainsi, une garantie de motivation intervient ici clairement et ouvre la voie à un examen objectif des résultats.

Utilisation interpersonnelle des résultats

1. Échanges entre collègues Au-delà de l’autoanalyse inhérente à l’étude du dossier, le perfectionnement pédagogique est susceptible de trouver appui dans la discussion du dossier avec des collègues. Il ne s’agit nullement d’enrayer d’une manière coercitive la confidentialité des résultats, car ces discussions peuvent se situer sur une base tout à fait volontaire. Il reste que la prise de conscience de points faibles conduit normalement à la recherche de solutions nouvelles et qu’un moyen d’en trouver est d’aborder la question avec des confrères dont les faiblesses porteraient sur des dimensions différentes. D’ailleurs, lors de l’enquête déjà citée, 64% des professeurs se sont dits désireux de discuter « certains résultats personnels » ou « l’ensemble du dossier individuel » avec des confrères de la même discipline (Q. 19). En prolongement de cette question, 57% se montraient « très favorables » ou « plutôt favorables » à ce que tous les professeurs d’un département fassent passer le test, dans le but exprès de discuter ensuite des résultats lors de réunions départementales.

Face à ces attitudes positives, nous fondons l’espoir que l’avènement de dossiers à la fois très personnels et très objectifs favorisera chez les professeurs une forme nouvelle de collaboration, où chacun bénéficiera de l’appui du groupe dans sa recherche de solutions adéquates à ses difficultés pédagogiques personnelles. Dans cette optique, il faut espérer que la neutralité même du dossier permettra d’aborder de telles difficultés dans un climat dénué d’agressivité ou de dénigrement.

2. Échanges avec un spécialiste Si des collègues peuvent très bien aider le professeur à repenser son approche pédagogique et ses comportements quotidiens en classe, ils n’ont pas, sauf exception, la compétence et la formation nécessaires pour analyser en profondeur le contenu du dossier mécanographique. Aussi, tout utiles et tout désirables qu’ils soient, les échanges entre collègues devraient être précédés ou accompagnés de rencontres individuelles ou en groupes avec un spécialiste (psychologue, conseiller d’orientation ou animateur pédagogique), spécialement entraîné à analyser et interpréter avec toutes les nuances nécessaires le contenu du dossier individuel.

En octobre 1969, suite à l’expérimentation dans six CEGEP, les membres du service PERPE offrirent un tel service de « relance » (follow-up). Environ 40% des professeurs qui avaient administré PERPE sentaient le besoin d’une entrevue pour clarifier des aspects de leur dossier demeurés obscurs. Devant la perspective d’un service PERPE à l’échelle provinciale, nous réalisons bien qu’il nous sera matériellement impossible d’assumer nous-même cette fonction de « relance ». C’est pourquoi nous envisageons, dès l’automne 1969, offrir à des professionnels locaux de l’orientation ou de l’animation un court stage d’entraînement qui leur permettrait de se familiariser avec notre instrument de mesure.

3. Échanges avec les étudiants Bien que les attentes des étudiants soient consignées dans le dossier des résultats, le professeur peut tirer profit d’une discussion ouverte avec eux de son dossier. En effet, les étudiants sont la source même des résultats ; ils sont mieux placés que quiconque pour clarifier le sens de leur insatisfaction et pour suggérer aux professeurs des alternatives possibles de techniques pédagogiques ou de modes d’interaction. L’enquête 1969 auprès des professeurs nous a permis de constater que les deux tiers d’entre eux se disent prêts à discuter avec leur classe, soit de l’ensemble de leur dossier, soit de certains résultats qui les ont étonnés.

Lors des entrevues de relance, à l’automne 1969, plusieurs professeurs ont fait savoir que la simple administration du test avait provoqué en classe d’enrichissantes discussions sur leur enseignement et qu’avant même de recevoir leur dossier ou de terminer la session, ils avaient adopté certaines suggestions des étudiants, à la grande satisfaction aussi bien de ces derniers que d’eux-mêmes.

Voici la transcription « arrangée » et fidèle de la page 178, basée sur le texte que vous avez fourni. J’ai corrigé les erreurs de lecture optique (OCR) pour rétablir les termes exacts (ex: « groupe » au lieu de « gmipe », « orientée » au lieu de « orientde », etc.).

Bref, si le test exige, pour être administré convenablement, un minimum de collaboration de la part du groupe évaluateur, son utilisation favorise en retour une meilleure communication et une plus grande ouverture d’esprit entre les deux parties. Pour favoriser cet échange professeur-étudiants, compte tenu des fréquents remaniements d’horaires d’une session à l’autre, le service PERPE espère offrir aux utilisateurs un délai maximum de trois semaines entre l’administration du test et le retour du dossier individuel.

Quelques projets

1. L’observation orientée Le test PERPE constitue certes un outil précieux d’informations sur la relation professeur-étudiants en classe. Cependant, les travaux de recherches actuels en milieu nord-américain indiquent plusieurs voies parallèles d’analyse de la situation d’enseignement : l’observation directe ou l’enregistrement magnétoscopique de la dynamique non-verbale en classe et sa codification par des évaluateurs entraînés, l’observation et la codification du contenu verbal (1), etc. L’utilisation de ces techniques pourrait grandement accroître nos informations sur l’origine des difficultés pédagogiques et, partant, nos possibilités d’action auprès des professeurs qui souhaiteraient renouveler leur enseignement.

2. Stages de perfectionnement Exception faite du projet SCOPE (Service de Consultation Pédagogique), que nous avons expérimenté durant un an au Collège de Maisonneuve et abandonné provisoirement, l’équipe PERPE s’est jusqu’ici cantonnée dans le secteur du diagnostic des difficultés pédagogiques. Nous sommes cependant conscients qu’il s’agit là d’un volet seulement d’une politique globale d’aide pédagogique individuelle pour le professeur de CEGEP. Dès l’an prochain, nous entrevoyons aborder le second volet, c’est-à-dire l’expérimentation systématique de services de perfectionnement offerts aux professeurs.

Le principal projet que nous envisageons entre dans la catégorie des « stages de perfectionnement ». Ces stages auraient cependant un caractère bien spécial, car la sélection des participants s’effectuerait à l’aide des profils individuels. Nous pourrions ainsi identifier des groupes de professeurs qui présentent un même type de difficulté pédagogique et bâtir à leur intention un programme d’activités de perfectionnement centré sur cette zone de difficulté. Nous sommes convaincus qu’une telle homogénéisation des groupes accroîtrait sensiblement l’efficacité de cette technique, déjà fort popularisée dans notre milieu.

Une seconde approche, plus locale, pourrait aussi être explorée. Advenant l’utilisation généralisée de PERPE dans certains CEGEP, il serait facile de tracer un profil-type des caractéristiques de l’enseignement donné dans ce CEGEP en cumulant les résultats individuels sur chacune des 61 dimensions du test. Ce profil servirait à localiser les besoins de perfectionnement les plus pressants au plan local. Au-delà de cette première démarche, l’examen des profils individuels faciliterait grandement l’identification des candidats susceptibles de bénéficier de chaque type de stage. Toutefois, en raison du caractère confidentiel de ces dossiers, un tel projet exigerait l’adhésion collective d’un corps professoral.

(1) Voir à ce sujet l’article de Gaston Gauthier (Prospectives, septembre 1969)

PERPE au service de la planification

Dans tout ce qui précède, nous avons restreint notre description aux seuls services que nous voulons rendre à notre client principal : le professeur de CEGEP. Les administrateurs locaux et provinciaux peuvent aussi tirer profit des informations recueillies lors de l’administration d’un instrument d’évaluation tel que PERPE. Nous avons montré plus haut qu’il est possible, sans porter atteinte au caractère confidentiel des dossiers individuels des professeurs, de cumuler ces résultats de façon à produire des moyennes de groupe qui nous éclaireront sur les tendances de l’activité pédagogique à l’échelle du réseau collégial.

Partant d’un échantillonnage représentatif des classes, nous pouvons, par exemple, tracer le portrait du professeur type du réseau en regroupant au niveau de chaque dimension les diverses mesures de réalité. Nous pouvons tout aussi aisément tracer le profil des attentes étudiantes en cumulant les moyennes des réponses à la question B pour chaque dimension. D’autre part, l’étude comparée des mesures d’insatisfaction, regroupées à l’échelle du réseau, permet d’identifier les forces et les faiblesses du professeur type.

D’autres variables peuvent être introduites dans ces analyses globales. Ainsi, la comparaison des réponses des garçons et des filles dans les classes mixtes nous éclairera sur les perceptions différentielles des sujets des deux sexes. Nous avons aussi l’information nécessaire pour étudier les perceptions comparées des étudiants du général et du professionnel, eu égard respectivement aux cours communs et aux cours de concentration.

Enfin, lors de notre principale expérimentation (avril 1969), nous avons obtenu de chaque professeur participant certains renseignements personnels (âge, sexe, statut civil, formation académique et/ou pédagogique, expérience d’enseignement, etc.) que nous pouvons mettre en correspondance avec les perceptions des étudiants, notamment leur degré de satisfaction.

S’il ne fait aucun doute que les administrateurs locaux s’intéresseront autant que ceux de la Direction générale de l’enseignement collégial aux résultats d’ensemble que nous commençons à publier, ils seront probablement plus attirés par les comparaisons inter-CEGEP auxquelles nous travaillons présentement. En effet, l’importance des sous-échantillons locaux qui composaient l’échantillon global 1969 nous permettait de tracer des « profils locaux » comparables les uns aux autres. À l’aide de ces profils, nous pourrons déterminer entre autres s’il existe des caractéristiques spécifiques au plan local quant au comportement des professeurs, aux attentes des étudiants ou aux zones de satisfaction et d’insatisfaction forte.

Bref, nous avons en dossier une foule d’informations qui, lorsqu’elles seront publiées, pourront servir d’instruments de réflexion pour tous les groupes consultatifs ou décisionnels qui travaillent à l’organisation des programmes, du régime pédagogique ou de la vie pédagogique au niveau collégial.

PERPE, l’an prochain

Que sera PERPE l’an prochain ? Des indices de l’orientation de nos activités apparaissent déjà, émaillés dans les pages qui précèdent. Nous avons voulu, en terminant ce survol rétrospectif, les reprendre succinctement et les compléter, de façon à tracer un aperçu prospectif des activités de l’équipe PERPE. Par cet engagement public, nous espérons que nos projets dépasseront le niveau des « promesses électorales » pour se traduire en réalisations concrètes.

Un service à l’échelle du réseau

Dès l’automne 1970, le test PERPE sera offert gratuitement et sur une base volontaire à l’ensemble des professeurs du réseau collégial public. Une entente sera établie avec chaque CEGEP eu égard à la distribution du matériel nécessaire et à l’envoi des feuilles de réponses pour fins de traitement mécanographique. Nous espérons pouvoir respecter un échéancier de trois semaines entre la date d’administration du test et la réception par le professeur de son dossier individuel de résultats.

Un service de relance

Nous avons pu constater par le passé que certains professeurs rencontrent des difficultés, soit dans l’interprétation de leur dossier, soit dans la traduction des informations qu’il contient en suggestions pédagogiques concrètes. Faute de pouvoir assurer nous-mêmes ce service de consultation, nous espérons pouvoir intéresser les professionnels des services de psychologie et d’orientation locaux qui, selon nous, possèdent toutes les qualifications nécessaires pour assumer ce rôle.

Un instrument perpétuellement révisé

Nous avons déjà souligné la souplesse du test PERPE, dont le contenu peut être indéfiniment modifié sans qu’il soit nécessaire de transformer le contenant. Aussi nous sera-t-il aisé d’évaluer régulièrement la valeur psychométrique et utilitaire des dimensions et d’en soustraire quelques-unes qui seront devenues moins pertinentes pour les remplacer par de nouvelles. Ce faisant, nous espérons continuer à cerner de très près la « réalité pédagogique », telle que vécue par la majorité des professeurs à l’intérieur du réseau. Corrélativement, nous nous efforcerons d’améliorer constamment la qualité du dossier de résultats remis à chaque professeur.

Des instruments spécifiques

Avec le test PERPE-PHILO, nous avons abordé cette année une nouvelle zone d’évaluation : celle du contenu de disciplines spécifiques. Non seulement ce premier essai sera-t-il poursuivi au moyen d’une expérimentation beaucoup plus étendue de cet instrument, mais nous comptons bien construire et expérimenter au moins un autre instrument de ce type.

Un marché plus étendu

Si le test PERPE a été conçu spécifiquement pour l’évaluation de l’enseignement au niveau collégial, il n’est pas dit qu’il ne pourrait pas être étendu à d’autres populations étudiantes. Nous croyons par exemple qu’il pourrait servir, presque sans modifications de contenu, à l’évaluation des cours de niveau universitaire. Parallèlement, nous songeons à une extension vers le secondaire. Dans ce cas, tant l’adéquacité des dimensions utilisées que le niveau du vocabulaire employé dans les descriptions devraient être réévalués soigneusement.

Enfin, à l’intention de nos collègues de langue anglaise, nous avons préparé une traduction du test PERPE. Notre instrument deviendra pour eux le S.P.O.T. test (Student’s Perceptions Of Teachers).

Des activités de perfectionnement

De même que dans le cas des instruments spécifiques, il s’agit là d’une voie toute nouvelle dans laquelle s’engagera l’équipe PERPE. Étant donné le caractère encore peu défini de ces projets, nous ne pouvons que renvoyer le lecteur à la courte description que nous avons présentée plus haut.

Des analyses et des publications

Enfin, nous poursuivrons et compléterons la tâche que nous avons amorcée cette année, à savoir l’analyse des données de l’expérimentation 1969 et la publication des résultats généraux. Deux types de publications sont prévus : des rapports techniques et des résumés synthétiques. Ces deux types de documents s’adresseront avant tout aux « gens du milieu » : administrateurs, professionnels, professeurs et étudiants. Compte tenu de la clientèle visée, nous nous efforcerons d’adopter un style et un langage qui ne rebuteront pas les personnes non initiées à la méthodologie scientifique.

Les rapports techniques n’auront pas une distribution aussi large que les résumés synthétiques : ils rejoindront avant tout les administrateurs locaux et provinciaux, de même que certains organismes directement intéressés à l’évolution de l’enseignement collégial. Toutefois, un catalogue de ces rapports circulera plus librement et permettra aux personnes intéressées d’obtenir, sur simple demande, copie de ces rapports. Quant aux résumés synthétiques, publiés régulièrement, nous tenterons de leur assurer une circulation maximum à l’intérieur du réseau collégial.

— FIN —

SOURCE : EDUQ.info – Centre de documentation collégiale (CDC).